🔭 Le moment Tchernobyl de l’IA

Comme un air de Wuhan en décembre 2019 ?

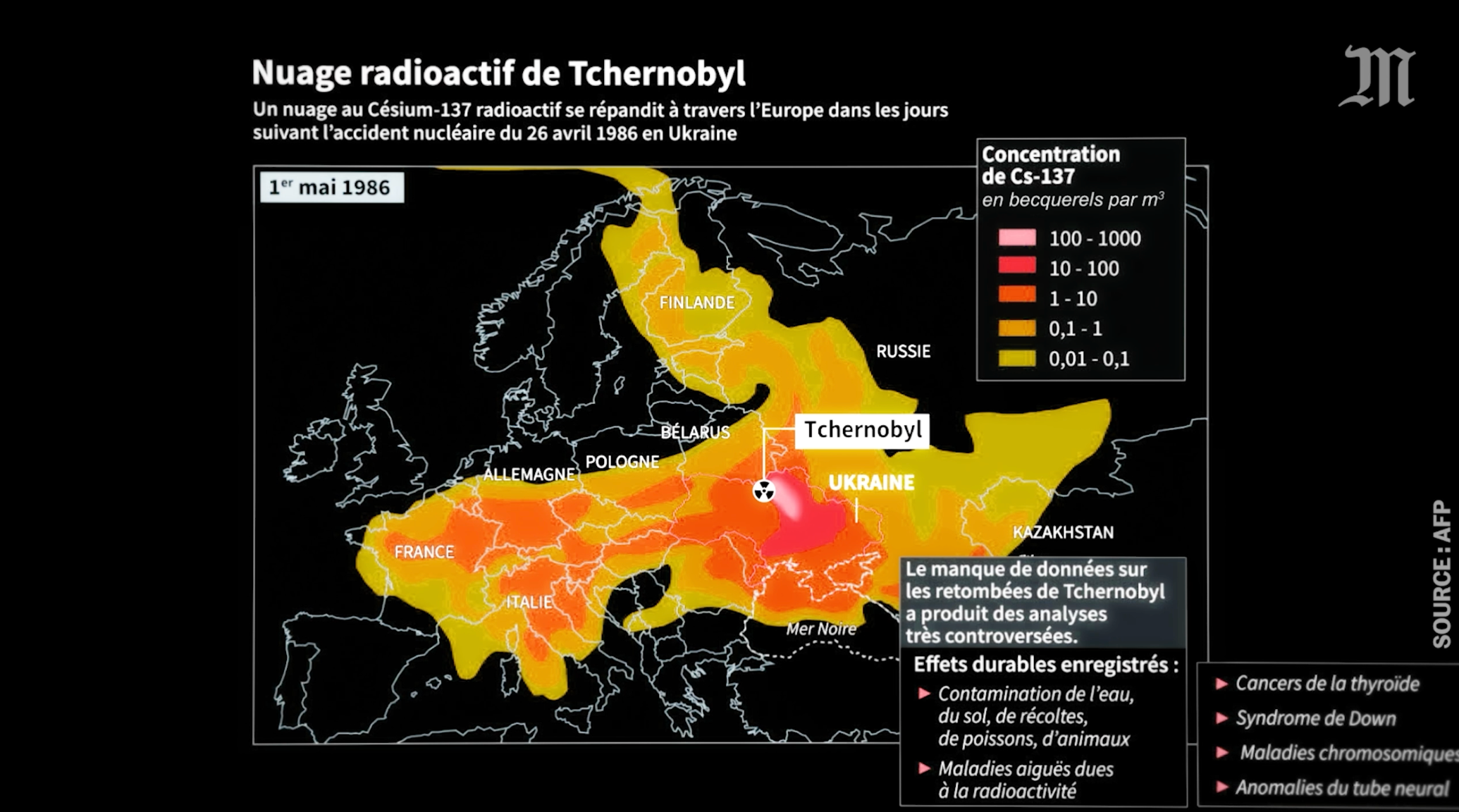

Il y a 40 ans, dans la nuit du 26 avril 1986, le réacteur numéro 4 de la centrale de Tchernobyl (Ukraine) explosait suite à un test de sûreté. Les mécanismes d'alerte qui auraient pu l'empêcher avaient été désactivés.

Résultat : le cœur du réacteur a brûlé à ciel ouvert. Pas glop. ☢️

Les conséquences sur la santé et l'environnement ont été énormes.

Suite à cet incident, le soutien de la population à l'industrie nucléaire s'est effondré : les pays avaient 90% de chances en moins de construire de nouvelles centrales.

Le trauma de la population est réel. On peut le comprendre.

Et sinon, c'est quoi le rapport avec l'IA ?

J'y viens. J'ai récemment déjeuné avec un collègue fraîchement revenu de la Silicon Valley. Très connecté avec les principaux décideurs de la Tech californienne, il m'a dit quelque chose qui m'a interpellé :

Là-bas, les pontes de la Tech craignent un moment Tchernobyl de l'IA

Un moment Tchernobyl de l'IA ? Je n'avais jamais entendu ces termes. Alors j'ai mené mon enquête. 🕵️♂️

Scénarios pas rigolos

Voici ce que je vous propose au menu aujourd'hui :

- On va définir ce que signifie un "moment Tchernobyl de l'IA" 🧐

- Je vais lister quelques-uns des joyeux scénarios possibles 😬

- Puis me focaliser sur les vrais risques selon moi ☝️

- ... et parler de comment s'y préparer dans la joie et la bonne humeur 🥳

Mais si vous voulez juste passer une bonne journée, vous pouvez aussi fermer cette newsletter et revenir à la prochaine. 😛

Un moment Tchernobyl pourrait réduire l'adhésion de la population au développement de l'IA

Qu'est-ce qu'un moment Tchernobyl de l'IA ?

Tchernobyl a été un moment précis où une catastrophe majeure s'est produite.

Quand on dit "moment Tchernobyl de l'IA", cela signifie qu'on pense qu'à un moment précis (on ne sait pas lequel), une catastrophe majeure (on ne sait pas laquelle) pourrait se produire.

Voilà l'idée. Les mots sont forts. Ils font peur. C'est le but.

Est-ce le fait de gens qui ont un agenda caché à promouvoir ? Des vendeurs de combinaisons radioactives de l'IA peut-être ? 🤔

Ce sont pourtant les mêmes qui construisent l'IA qui alertent contre ce risque (Sam Altman, Dario Amodei...).

Bien avant la sortie de ChatGPT, c'est un chercheur et philosophe, Nick Bostrom, qui alertait sur les risques de l'IA dans son livre de référence "Superintelligence" que j'ai lu et qui m'a fasciné.

Un livre majeur, intelligent, à lire uniquement si vous n'êtes pas anxieux de nature. Vous ne verrez plus les trombones de la même manière après. 📎

Les risques de l'IA

Non, ce n'est pas ça le risque. 😅

Le problème est justement qu'on ne sait pas à quoi pourrait ressembler ce risque (ni même s'il se passera quelque chose). On pense en revanche que les risques sont suffisamment tangibles pour en parler.

Voici ma liste des risques, d'après ma lecture du livre de Nick Bostrom et mes (trop) nombreuses lectures d'articles en ligne :

- 🧨 Un usage militaire de l'IA autonome. Donnez à des drones équipés d'IA le pouvoir de décider seuls où tirer. Ou des robots humanoïdes... depuis peu sur le champ de bataille en Ukraine. Bref, what could possibly go wrong? C'est précisément le désaccord majeur entre Anthropic (Claude) et le Pentagone ces dernières semaines.

- ⚡️ Des cyberattaques massives sur les infrastructures critiques. Les centrales ne peuvent plus produire d'énergie (ou en mode "dégradé"). Les aéroports ne tournent plus, sauf à recourir à nouveau aux tableaux blancs, comme lors du bug Windows dû à une mise à jour de Crowdstrike (le plus grand bug informatique involontaire de l'histoire à ce jour).

Ces cyberattaques pourraient être coordonnées par quelqu'un grâce à une IA très puissante, comme Claude Mythos, le nouveau Claude jugé trop dangereux pour être publié immédiatement. - 📉 Un crash financier dû à des agents IA. On fait déjà du micro-trading avec des décisions prises chaque milliseconde. On délègue de plus en plus à des IA les décisions. Que se passe-t-il quand une IA intelligente joue avec la Bourse ? De toute évidence, les cotations seraient suspendues, comme c'est déjà arrivé par le passé.

- 📰 Un effondrement de la vérité. Plus précisément des manipulations électorales. Ca n'a jamais été aussi facile à faire. Des faux médias synthétiques produits par milliers, ou des faux comptes de réseaux sociaux, pourraient influencer les élections, déclencher des protestations et des violences civiles.

Bon, on vit déjà en plein dedans quand on y réfléchit bien. - 🦠 Production d'armes biologiques facilité par l'IA. Il n'a jamais été aussi simple d'obtenir des informations pour en produire. S'il suffit d'un peu de volonté pour créer une arme très dangereuse... les risques peuvent être importants.

On pense souvent qu'il suffit d'une personne malveillante pour utiliser une IA, mais c'est faux. Une IA "hors de contrôle" pourrait, même involontairement, créer des problèmes majeurs. Je pense en particulier au crash financier ou aux cyberattaques.

☝️ Mon analyse

Bon. Vous êtes bien silencieux tout à coup. 🥳

Comme les centrales nucléaires qu'on a pratiquement arrêté de construire après Tchernobyl. 🙃

Récemment, quelqu'un disait :

Être à San Francisco aujourd'hui, c'est comme être à Wuhan fin 2019. On sait qu'il va se passer quelque chose de gros, mais le monde entier ne le sait pas encore.

Je trouve que cette phrase touchait juste, grâce à son parallèle avec le Covid-19.

Maintenant concrètement, quelle est la probabilité de ces risques ?